Մի շարք ընկերություններ, այդ թվում Microsoft і Facebook, և նույնիսկ Հարավային Կալիֆորնիայի համալսարանի հետազոտողները մշակում են տեխնոլոգիաներ՝ պայքարելու խորը կեղծիքների դեմ և կանխելու դրանց տարածումը դեղին լրատվամիջոցների և ընդհանրապես ապատեղեկատվության միջոցով: Սակայն մի խումբ գիտնականների, այնուամենայնիվ, հաջողվել է խաբել նրանց։

Սան Դիեգոյի Կալիֆոռնիայի համալսարանի համակարգչային գիտնականների թիմը նախազգուշացրել է, որ դեռևս հնարավոր է խաբել առկա խորը կեղծ հայտնաբերման համակարգերը՝ յուրաքանչյուր տեսանյութի կադրում «մրցակցող օրինակներ» կոչվող մուտքային տվյալներ մտցնելով: Գիտնականները ներկայացրել են իրենց բացահայտումները WACV 2021 Computer Vision կոնֆերանսում, որն անցկացվել է առցանց անցած ամիս:

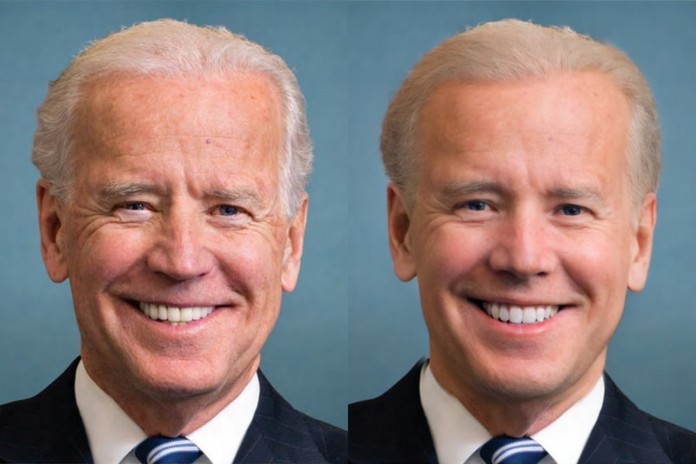

Մրցակցող օրինակները փոքր-ինչ փոփոխված մուտքեր են, որոնք արհեստական ինտելեկտի համակարգերին, օրինակ՝ մեքենայական ուսուցման մոդելներին, ստիպում են սխալվել: Բացի այդ, թիմը ցույց տվեց, որ հարձակումը դեռևս գործում է տեսանյութը սեղմելուց հետո։ Վերևում գտնվող տեսանյութում գիտնականները ցույց են տալիս, որ XceptionNet-ը՝ խորը կեղծ դետեկտորը, իրենց մրցակցող տեսանյութը պիտակավորում է որպես «իրական»:

Այս դետեկտորներից շատերն աշխատում են՝ հետևելով դեմքերին տեսանյութում և կտրված դեմքի տվյալները վերլուծության համար ուղարկելով նեյրոնային ցանց: Այնուհետև նեյրոնային ցանցը կվերլուծի այս տվյալները և կգտնի տարրեր, որոնք սովորաբար վատ են վերարտադրվում խորը կեղծիքներում, ինչպիսիք են թարթումը:

Տեղադրելով մրցակցող օրինակներ՝ հետազոտողները պարզեցին, որ նրանք կարող են խաբել այս խորը կեղծ դետեկտորներին՝ ենթադրելով, որ տեսանյութերն իրական են:

Նրանք թղթում նշում են, որ «այդ խորը կեղծ դետեկտորները գործնականում օգտագործելու համար կարևոր է գնահատել դրանք հարմարվողական հակառակորդի դեմ, որը տեղյակ է այս պաշտպանության մասին և միտումնավոր փորձում է կոտրել այն: Մենք ցույց ենք տալիս, որ խորը կեղծիքի հայտնաբերման ժամանակակից մեթոդները կարելի է հեշտությամբ շրջանցել, եթե հարձակվողը լիովին կամ նույնիսկ մասամբ տեղյակ է դետեկտորի մասին»:

Ինչպես ցույց են տվել այս գիտնականները, ապատեղեկատվության դեմ պայքարի համար մշակվող ավտոմատացման տեխնոլոգիաները դեռևս չեն համապատասխանում իրենց առաջադրանքին:

Կարդացեք նաև.